Technische Analyse des DVDFab NVIDIA AI Enhancers auf RTX-Video-HDR

Inhaltsverzeichnis

Einführung: Herausforderung der vorherrschenden Wahrnehmungen von KI-HDR

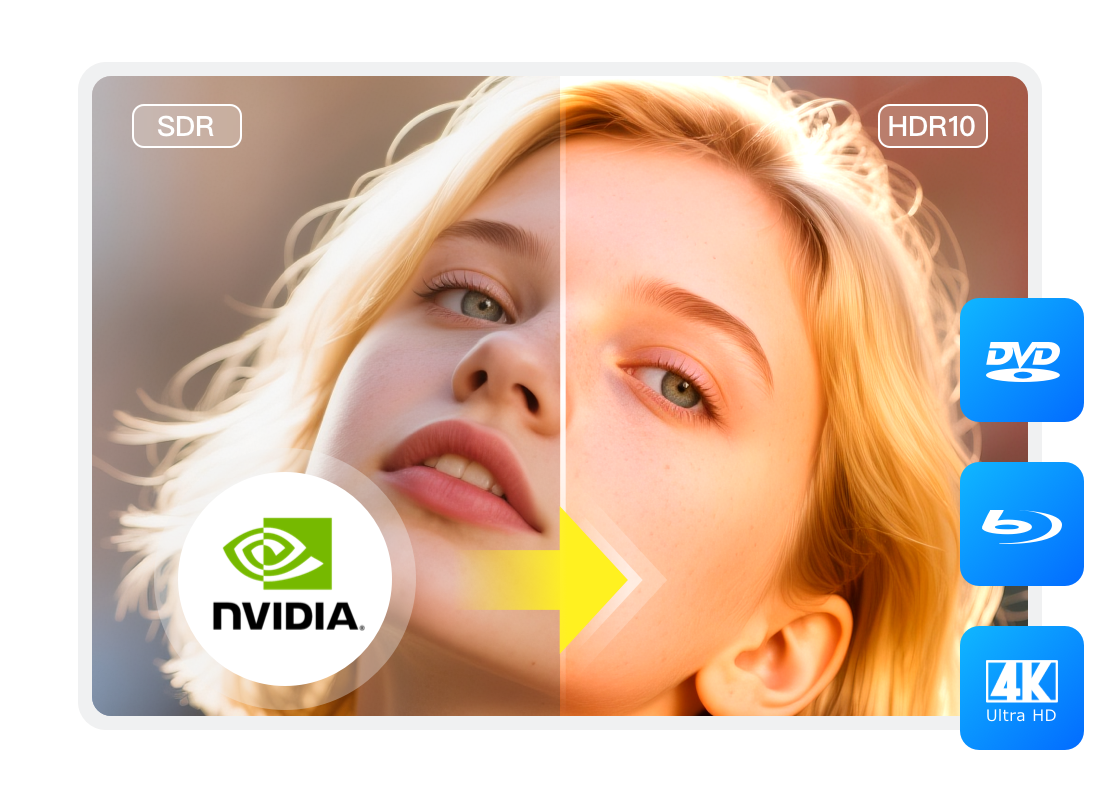

Trotz der raschen Fortschritte in der KI-Videobearbeitung sind Missverständnisse über die Echtzeit-SDR-zu-HDR-Konvertierung nach wie vor weit verbreitet. Weit über einfache Helligkeits-/Kontrastfilter hinaus nutzen die neuesten NVIDIA-RTX-Video-HDR-Pipelines anspruchsvolle tensorbasierte Inferenz, um den Dynamikbereich und die Farbtreue zu rekonstruieren, die gelegentlich sogar native HDR-Codierungen übertreffen können. Dieser Artikel stellt die „oberflächlichen“ Wahrnehmungen von KI-HDR infrage und untersucht, was die nächste Generation von Lösungen wirklich von ihren Vorgängern unterscheidet.

🌨️ Anmerkung: Die technischen Prinzipien von NVIDIA RTX HDR beziehen sich auf die Nutzung der Tensor Cores der RTX-GPUs zur Durchführung einer KI-gesteuerten frame-by-frame Videoanalyse. Das Ergebnis ist ein dynamisches HDR10-Remapping, das Farbe und Kontrast weit über einfaches Tone-Mapping hinaus rekonstruiert.

RTX Video HDR: Technische Grundlagen & Betriebsprinzipien

Setzen des Maßstabs: HDR vs. SDR – Gamut, Helligkeit und Dynamikbereich

HDR10 vs. SDR: HDR10 unterstützt einen breiteren Farbraum (Rec.2020 vs. Rec.709), einen höheren Dynamikbereich (bis zu 1.000 Nits) und eine 10-Bit-Tiefe pro Kanal, was im Vergleich zu SDR reichhaltigere visuelle Details und sanftere Farbverläufe ermöglicht.

Der technische Graben zwischen SDR und HDR10 ist erheblich: Während SDR (Standard Dynamic Range) typischerweise auf den Farbraum Rec.709, 8 Bit pro Kanal und eine Spitzenhelligkeit von weniger als 300 Nits angewiesen ist, nutzt HDR10 Rec.2020, 10-Bit-Quantisierung und bis zu 1.000 Nits oder mehr. Dieser Unterschied ist nicht „trivial“; er bildet die Grundlage der Herausforderung, die jede KI-gesteuerte Pipeline überwinden muss, um Ausgaben zu erzeugen, die visuell und strukturell mit nativen UHD-Blu-ray- oder professionellen HDR-Mastern übereinstimmen.

Wie Tensor Cores Echtzeit-KI-Inferenz ermöglichen

Im Gegensatz zu herkömmlichen CPU-gebundenen Video-„Filtern“ nutzen die NVIDIA-RTX-Pipelines dedizierte Tensor Cores für parallele KI-Inferenz. Jeder Frame wird über Dutzende (oder Hunderte) dieser Beschleuniger verteilt, die für gemischte Präzisionsberechnungen optimiert sind und so eine hohe Bildqualität bei effizienter Auslastung der GPU-Ressourcen ermöglichen.

Szenenadaptives Tone-Mapping und Enhancement

Anstatt statische Kurven anzuwenden, verwendet RTX Video HDR eine frame-by-frame, kontextbewusste Verbesserung: Ein neuronales Netzwerk bewertet nicht nur die durchschnittliche Helligkeit, sondern auch den lokalen Kontrast, Änderungsraten und die „Szenenintention“, indem es den optischen Fluss und Farbhistogramme analysiert. Dies ermöglicht die Erhaltung von Schattendetails, die Wiederherstellung von Mitteltönen und die Unterdrückung von Artefakten – Aufgaben, bei denen herkömmliche Upscaler oder LUT-basierte Konvertierungen typischerweise scheitern.

Helligkeits-/Farb-Optimierungslogik

Das KI-Modell ist so abgestimmt, dass es erweiterte Helligkeiten ohne „Clipping“ erkennt und rekonstruiert, gesättigte Farben in Richtung der Rec.2020-Ziele drängt und Banding durch intelligentes Dithering und Bewusstsein für die Farbtiefe reduziert. Es geht weniger um „knallige“ Effekte und mehr um technische Übereinstimmung und visuelle Subtilität.

Parallelität & Echtzeit-Pipeline

Wie bei klassischen Video-Workloads hängt die reale Leistung von der Lastverteilung ab: der Kombination aus GPU-Speicherbandbreite, Verfügbarkeit der Tensor Cores und Orchestrierung auf Treiberebene. Praktische Optimierungen – wie das Batching von Frames, die Minimierung von Speicherübertragungen und die Anpassung der Inferenzgranularität für Szenenwechsel oder schnelle Bewegungen – unterscheiden Pipelines, die kaum Schritt halten, von solchen, die die Wiedergabequalität sichtbar verbessern.

| Spezifikation | HDR10 | SDR |

| Farbraum | Rec.2020 | Rec.709 |

| Bit-Tiefe | 10 Bit/Kanal | 8 Bit/Kanal |

| Maximale Helligkeit | Bis zu 1.000 Nits (manchmal mehr) | ~300 Nits |

| Dynamikbereich | Breit (echtes Schwarz bis hohe Nits) | Begrenzt |

| Format-Unterstützung | HEVC/AVC, UHD Blu-ray | H.264/AVC, Blu-ray/DVD |

| Metadaten | Statisch/dynamisch unterstützt (z. B. HDR10) | Keine HDR-Metadaten |

👉 Wesentliche Erkenntnisse:

- HDR-Videos werden nicht nur durch „hellere“ Highlights definiert, sondern auch durch strukturell überlegene Farb-, Gradient- und Kontrastabbildung.

- Tensor Cores sind der zentrale Ermöglicher für Echtzeit-Enhancements – sie skalieren gut, selbst auf Einstiegs-RTX-GPUs, dank Parallelisierung.

- Echte, szenenadaptive KI-Logik geht weit über einfache Upsampling-Techniken hinaus.

DVDFab NVIDIA AI Enhancer: Vollständige Verarbeitungspipeline

Effiziente und hochpräzise SDR-zu-HDR-Konvertierung hängt nicht nur von der reinen GPU-Leistung oder der „Tiefe“ des KI-Modells ab. Die wahre Effizienz des Workflows erfordert eine eng integrierte, schrittweise Pipeline – jeder Schritt ist darauf ausgelegt, die Qualität zu maximieren und gleichzeitig manuelle Eingriffe, Benutzereinstellungen oder unerwünschte Artefakte zu minimieren. DVDFab NVIDIA AI Enhancer bietet eines der robustesten Beispiele für praktische, realistische KI-HDR mit einem klaren Fokus auf Kompatibilität und Automatisierung.

Eingangsanalyse & Vorverarbeitung

Die Pipeline beginnt mit einer tiefen Eingangsprüfung, um die Integrität des Video-Streams, die Bildfrequenz, die Auflösung und das Format (z. B. Blu-ray-MKV, MP4 oder herkömmliche DVD-VOBs) zu überprüfen. Die Vorverarbeitung kontrolliert außerdem Farbraum-Flags und eingebettete Metadaten, da die ordnungsgemäße Identifizierung von SDR Rec.709/601 oder YUV-Werten entscheidend für die Genauigkeit der anschließenden Analyse ist.

Format- & Metadatenerkennung

Automatisierte Routinen extrahieren Containerdetails (z. B. AVC/HEVC-Codec), Audiostreams, Zeitstempel, Kapitelstrukturen und benutzerdefinierte Schnittpunkte. Diese Phase gewährleistet, dass im Übergang von der Vorverarbeitung zur KI-Verbesserung nichts „kaputtgeht“ und dass das ausgehende HDR-Video vollständig mit den Anforderungen der Geräte- und Ausgabespezifikationen konform ist.

Rauschreduzierungs- & Farbstandardisierungsmethoden

Im Gegensatz zu herkömmlichen „Videoverbesserungs“-Schritten werden Rausch- und Farbnormalisierungen durch fortschrittliche zeitlich-räumliche Algorithmen bearbeitet, die speziell für SDR-Inhalte optimiert sind. Das Hauptziel: Mückenrauschen, Kompressionsartefakte und inkonsistenten Weißabgleich zu unterdrücken – ohne den Dynamikbereich abzuflachen oder die ursprüngliche Szenenintention zu verlieren.

KI-gesteuertes Helligkeits-, Farb- und Detail-Processing

Das Herz des Enhancers ist ein KI-Modell, das entworfen wurde, um selektiv Helligkeit neu zuzuordnen, lokalen Kontrast wiederherzustellen und Farbverläufe zu rekonstruieren, die beim SDR-Encoding verloren gingen. Durch die Nutzung der Tensor Cores der GPU können Hunderte von Frames gleichzeitig verarbeitet und verglichen werden – was es dem Netzwerk ermöglicht, die Szenenstruktur zu erlernen und adaptive Tone-Mapping-Kurven anzuwenden, anstatt feste LUTs oder rein interpolierte „Schätzungen“.

Wichtig ist, dass kein übermäßiges Überschießen oder unnatürliches Kantenleuchten eingeführt wird, da die Compliance der Ausgabe an den technischen Zielvorgaben von HDR10 gemessen wird.

GPU-beschleunigte parallele Berechnung

Latenz und Durchsatz werden durch die Lastverteilung bestimmt: Maximierung der Auslastung der Tensor Cores, Anpassung der Batch-Größe und Optimierung der Datenbewegung zwischen VRAM und RAM. Die Implementierung von DVDFab minimiert Systemspeaks und kann von mittleren RTX-20er-GPUs bis hin zu leistungsstarken Modellen hochskaliert werden – ein wichtiger Aspekt für Benutzer, die mit weniger leistungsfähiger Hardware arbeiten.

Szenengranulare dynamische Mapping-Strategien

Szenen und sogar Unterszenen werden unabhängig auf Bewegung, Schatten-/Helligkeitstrennung und Farbakzente analysiert. Dies ermöglicht eine Anpassung für jede Aufnahme oder Szene, die die „Natürlichkeit“ bewahrt – im Gegensatz zu globalen, statischen Filtern, die die Vielfalt innerhalb der Frames ignorieren.

Abschließendes HDR-Mapping: Synthese & Ausgabe

Sobald die KI-Inferenz abgeschlossen ist, werden die tone-gemappten HDR-Frames zu einem kontinuierlichen Videotrack synthetisiert, wobei die ursprüngliche Bildfrequenz, das Seitenverhältnis und – wo zutreffend – die Kapitelpunkte respektiert werden.

Die Ausgabe wird anschließend mit aktualisierten HDR10-Metadaten verpackt, die AV-Synchronisation bleibt erhalten und die vollständige Unterstützung für UHD-Container-Spezifikationen wird gewährleistet.

Ausgabewrapper: HEVC/H.265, HDR10

Die Kodierung unterstützt voll HEVC/H.265 und HDR10, wo zutreffend. Die Pipeline ist darauf abgestimmt, Rekodierungsartefakte zu minimieren, bitgenaue Kapitelnavigation bereitzustellen und eine vollständige Audio-Passthrough-Funktion (z. B. Dolby Atmos) aufrechtzuerhalten.

Systemoptimierung & Ressourcenzuweisung

Der Enhancer überwacht kontinuierlich die Systemlast und weist dynamisch Rechenkerne und VRAM basierend auf der Warteschlangentiefe und der Komplexität der Aufgaben zu. Auf Multi-GPU-Plattformen stehen Batch-Unterteilungen und Synchronisationslogik zur Verfügung, die einen optimalen Durchsatz sicherstellen – egal ob für Einzeldateien oder Batch-Jobs.

Wichtigste Erkenntnisse:

- Automatisierte Workflows führen zu minimalem manuellem Aufwand für die Benutzer.

- Die KI-geführte Anpassung auf Szenenebene produziert „lebensnahere“ HDR-Ergebnisse als globale statische Filter.

- Die Plattform ist skalierbar – Einstiegs-RTX-GPUs sind ausreichend für nicht-realtime, große Batch-Jobs.

HDR10 vs. SDR: Technische & visuelle Implikationen

Moderne Videoverbesserungen erfordern ein scharfes Verständnis sowohl der objektiven technischen Lücken als auch der subjektiven visuellen Auswirkungen, die SDR- und HDR10-Material unterscheiden. Während viel Marketing diese Unterschiede vereinfacht, sind die Anforderungen real: Die Konvertierung muss sowohl den Compliance-Standards entsprechen als auch eine merklich verbesserte Benutzererfahrung bieten.

Erweiterung der Farbräume: Rec.709 zu Rec.2020

HDR10 vs. SDR Farbraum: SDR verwendet Rec.709 (~35 % der sichtbaren Farben), während HDR10 Rec.2020 nutzt und damit bis zu ~75 % erfasst – was reichhaltigere, lebendigere Bilder mit subtileren Farbverläufen und weniger ausgeprägtem Banding ermöglicht.

Technisch enthalten die Farbpunkte von SDRs Rec.709 nur einen Bruchteil des sichtbaren Spektrums, was die erreichbare Lebhaftigkeit und Farbnuance einschränkt. Der Standard Rec.2020 von HDR10 erweitert diesen Bereich deutlich, was die Anzeige von lebhaften Rot-, gesättigten Grün- und tiefen Blautönen ermöglicht, die in herkömmlichen Heimvideos selten zu sehen sind. Für praktische Zuschauer übersetzt sich dies direkt in eindringlichere Bilder und einen subjektiven „Pop“, der zuvor unmöglich war.

Helligkeits-/Kontrast-Benchmarks

HDR10 erhöht die Spitzenhelligkeit auf bis zu 1.000 Nits (oft mehr) im Vergleich zur SDR-Obergrenze von ~300 Nits. Bemerkenswert ist, dass auch die Schwarzdarstellung verbessert wird – entscheidend für schattenreiche Inhalte. In gemessenen Benchmarks ermöglicht korrekt gemastertes HDR10 bis zu das Dreifache des sichtbaren Dynamikbereichs. Das zeigt sich als Glitzern der Highlights, Details in Wolken oder feine Strukturen in nahezu schwarzen Texturen – Effekte, die einfache SDR→HDR-„Filterung“ nicht nachahmen kann.

Detail-Wiederherstellung in realen Szenarien

Mit fortschrittlichem KI-Mapping kann die SDR-zu-HDR-Verbesserung tatsächlich Schatten- oder Highlight-Details wiederherstellen, die aufgrund der Begrenzungen des herkömmlichen Masterings „verloren“ gingen. Das neuronale Modell nutzt kontextuelle Hinweise (z. B. umgebende Frame-Historie, Chroma-Beziehungen), um plausible Details zu rekonstruieren – manchmal mit subjektiv besseren Ergebnissen als schlecht kodiertes natives HDR oder zumindest auf Augenhöhe mit hochwertigen HDR-Mastern in Alltagsszenen.

Benutzerwert: SDR-zu-HDR für Legacy-Inhalte

Für Benutzer, die umfangreiche SDR-Archive besitzen, ist der Einfluss greifbar: KI-HDR erweitert nicht nur die Kompatibilität auf moderne Displays, sondern verlängert auch die produktive Lebensdauer wertvoller Legacy-Discs und Sammlungen. Die Verbesserung ist formatbewahrend, sodass kritische Metadaten (Seitenverhältnis, Kapitel, Audio-Synchronisation) intakt bleiben und unnötige Kopfschmerzen durch manuelle Formatmigration vermieden werden.

Praktische Geschwindigkeit & Benutzbarkeit der NVIDIA-RTX-HDR-Prozesse

Wie praktikabel ist die KI-gestützte SDR-zu-HDR-Videoverbesserung für Arbeitende, Profis und Enthusiasten gleichermaßen? Während branchenspezifische Demos oft „Hero“-Hardware demonstrieren, dreht sich die Realität für die meisten Benutzer um das Gleichgewicht zwischen Geschwindigkeit, Qualität und verfügbaren GPU-Ressourcen. Die RTX-Video-HDR-Pipelines – und insbesondere die Umsetzung in DVDFab – zeigen, wie technologische Innovation und Benutzerfreundlichkeit zusammenlaufen können.

Ausnutzung der Tensor-Core-Parallelität

Die Tensor Cores von NVIDIA sind speziell für schnelle Matrixoperationen konzipiert, die zentral für die Inferenz im Deep Learning sind. Auf Video angewendet, kann anstelle eines einfädigen Filters jeder Frame – oder sogar einzelne Tiles – parallel verarbeitet werden, wobei die Inferenzlasten auf verfügbare Kerne verteilt werden. Im Vergleich zu älteren CUDA-beschleunigten oder CPU-gebundenen HDR-Workflows kann der Durchsatz auf Einstiegs- bis Mittelklasse-RTX-Hardware um das 4- bis 8-Fache gesteigert werden – und noch mehr auf High-End-Modellen. Für die Praxis bedeutet das: Echtzeit- oder nahezu Echtzeit-Wiedergabe wird in Szenarien erreichbar, in denen CPU-Pfade vollständig zum Stillstand kommen würden.

Benchmarking: RTX HDR vs. CPU & Legacy-KI

Leistung von RTX Video HDR: Einstiegs-RTX-2060-GPUs verarbeiten 1080p SDR→HDR mit bis zu 60 fps, 4K mit ca. 18–25 fps, wobei Latenz und Qualität verbreitete CPU-basierte Tools bei identischen Quellinhalten und Kodierungsparametern deutlich übertreffen.

Echte Benchmarks (z. B. TechPowerUp, 2024) zeigen durchgehend, dass RTX-betriebene KI-HDR traditionelle Werkzeuge übertrifft. Ein gängiger CPU-basierter Transcoder erreicht z. B. 4–8 fps bei 4K-Konvertierungen, während RTX-Pipelines auf demselben System über 20 fps liefern – was Workflow-Unterbrechungen minimiert. Wichtig ist, dass die Auslastungsspitzen (VRAM, Stromverbrauch) stabil bleiben und Batch-Operationen sowie Multitasking auf gut konfigurierten Systemen unterstützen.

Erreichbare Echtzeit-UHD/4K/8K-Streams

HD- und UHD/4K-„Echtzeit“ sind für nahezu jede Desktop-RTX-GPU der letzten Generationen erreichbar, sofern Treiber- und Anzeigekette korrekt konfiguriert sind. 8K-Konvertierung ist auf leistungsstarken Karten (z. B. RTX 4070/4080/Ti) realisierbar, erfordert aber gegebenenfalls eine sorgfältige Workflow-Balancierung (z. B. geringere gleichzeitige Jobanzahl). Auffällig ist, dass der häufigste Engpass nicht die GPU selbst ist, sondern eine unsaubere HDR-Behandlung durch Treiber oder Betriebssystem – was unterstreicht, dass das technische Ökosystem ebenso entscheidend ist wie die Hardware.

Latenz-, Ressourcen- und Effizienzmetriken

Mit der richtigen Optimierung laufen Enhancement-Pipelines innerhalb von ca. 50–80 % des theoretischen maximalen Inferenzdurchsatzes einer bestimmten GPU – ein signifikanter Fortschritt gegenüber historischen CPU+GPU-Hybridarchitekturen, die oft viel früher durch Ressourcenkonflikte oder ineffizienten Speichertransfer ausgebremst wurden. Benutzer müssen nicht ständig Puffergrößen, VRAM-Grenzen oder Kodierungsflags feinjustieren; Presets und „Auto“-Optionen sind für eine schnelle Adoption vorbereitet.

| GPU/CPU | 1080p SDR→HDR (fps) | 4K SDR→HDR (fps) | Batch-Stabilität | Durchschnittlich verwendetes VRAM (GB) |

| Intel i7-12700K | 15 | 4 | Mittel | 4 |

| RTX 2060 | 60 | 18–25 | Hoch | 5–6 |

| RTX 4070 | 90+ | 40+ | Sehr hoch | 7–8 |

Wesentliche Erkenntnisse:

- KI-HDR ist nicht nur für „Power-User“ reserviert; die praktische Leistung ist inzwischen breit verfügbar.

- Die meisten Geschwindigkeitsprobleme resultieren aus Display-/Software-Integration – nicht aus Einschränkungen der RTX-Architektur.

- Batch- und automatisierte Workflows sind auf Mainstream-GPUs stabil und effizient.

DVDFab-Integration, Workflow-Optimierung & Benutzererfahrung

Der volle Wert einer fortgeschrittenen KI-Videobearbeitungslösung liegt nicht nur in reiner Verarbeitungsgeschwindigkeit oder Genauigkeit, sondern in einem integrierten Workflow und einer durchdachten Benutzererfahrung. DVDFab NVIDIA AI Enhancer – der die RTX-Video-HDR-Fähigkeiten in seine Copy-, Ripper- und UHD-Creator-Module integriert – priorisiert Prozessautomatisierung und Formatbewahrung in ungewöhnlichem Maß.

Integration des Kopiermoduls (BD-zu-UHD-HDR-Upscale)

Innerhalb des Kopiermoduls können Benutzer SDR-Blu-ray- oder herkömmliche DVD-Quellen für die direkte SDR-zu-HDR-Hochskalierung auswählen. Das System erkennt automatisch kompatible Dateien, scannt die Kapitelstruktur und bewahrt – wo möglich – Navigationsmenüs. Diese nahtlose Pipeline reduziert Übergabefehler und eliminiert manuelle Vorverarbeitung, eine häufige Frustrationsquelle bei Konkurrenzprodukten.

Ripper-Modul: Automatisiertes Multi-Format-HDR

Für Benutzer, die Disc-Sammlungen digitalisieren oder Heimvideoarchive verwalten, ist das Ripper-Modul für One-Click-Konvertierung über ein Spektrum von Ausgabeformaten optimiert – z. B. MKV, MP4, HEVC HDR10. Die KI-Verbesserung wird automatisch für SDR-Eingaben aktiviert, und die Ausgabeprofile sind vorkonfiguriert, um korrekte HDR-Metadaten einzufügen, die Quellauflösung beizubehalten und mehrkanalige Audiospuren synchron zu halten.

UHD-Creator-Synergie

Das UHD-Creator-Modul unterstützt das Erstellen maßgeschneiderter UHD-Discs – damit lassen sich wiederhergestellte SDR-Inhalte professionell als HDR10-konforme, menügestützte Discs kodieren. Das KI-Modell stellt sicher, dass Quellkapitel und Untertitel erhalten bleiben, was für herkömmliche Disc-Upscaler eine dauerhafte Herausforderung darstellt. Über die Videoverbesserung hinaus verkürzt diese enge Verbindung zu Authoring- und Brennfunktionen die Distanz zwischen Wiederherstellung, Archivierung und Weitergabe.

UX: Ein-Klick-Automatisierungen und Profile

Die Benutzererfahrung wird durch umfangreiche vordefinierte Profile für gängige Szenarien weiter optimiert: BD-zu-UHD, SDR-Heimvideo zu Streaming, alte DVD-Konvertierung in HDR-Filmdatei usw. Alle Profile nutzen die KI-Erkennung, um Fehlklassifizierungen des Quellmaterials zu minimieren; erweiterte Optionen stehen Power-Usern zur Verfügung, stellen jedoch für Einsteiger kein Hindernis dar.

Fazit

RTX Video HDR nutzt GPU-basierte KI-Technologie, um SDR-Inhalte in vollständig konforme HDR10-Videos zu konvertieren und setzt damit einen neuen technologischen Maßstab im Bereich der Videoverbesserung. Dieser Fortschritt hebt das traditionelle filterbasierte Verarbeitungsparadigma auf eine szenenadaptive Tiefenwiederherstellung an und erreicht Effekte, die in Bezug auf Farbtiefe, Dynamikbereich und Detailwiedergabe mit nativer HDR-Produktion vergleichbar sind oder diese sogar übertreffen. Der DVDFab NVIDIA AI Enhancer ist ein praktisches Beispiel für diese Technologie: Nahtlos integriert in die Module Kopieren, Ripper und UHD-Erstellung kombiniert er automatisierte Verarbeitung, Formatbewahrung und systemweite Optimierung und zeigt einen konkreten Implementierungsweg für KI-gesteuerte HDR-Enhancement-Workflows.

Für Endbenutzer und professionelle Inhaltsersteller bedeutet dies eine signifikante Verbesserung der Videoqualität ohne zusätzliche technische Barrieren und fügt bestehenden physischen Medienbibliotheken echten Mehrwert hinzu. Damit markieren die RTX-Video-HDR-Pipeline und ihre Umsetzung in Produkten wie DVDFab einen wichtigen Wendepunkt in der Verarbeitung von Videoinhalten – mit weitreichenden und langfristigen Auswirkungen auf technologische, operative und ökosystemische Ebenen.